在数字化浪潮中,用户行为数据已成为企业精细化运营、产品优化和智能推荐的核心驱动力。作为国内领先的在线旅行服务平台,携程面临着海量、高并发的用户行为数据处理挑战。本文将深入剖析携程如何构建一个日处理能力高达20亿条数据的实时用户行为服务系统,并分享其数据处理服务的关键架构实践。

一、系统核心挑战与设计目标

携程实时用户行为服务系统主要承载着用户点击、搜索、浏览、预订等全链路行为日志的实时采集、处理与分发。其面临的核心挑战包括:

- 数据规模巨大:日均处理数据量达20亿条,高峰时段QPS超过百万。

- 实时性要求高:行为数据需在秒级甚至毫秒级内完成处理,以支持实时风控、个性化推荐等场景。

- 数据可靠性保障:必须保证数据不丢失、不重复,确保下游业务分析的准确性。

- 系统可扩展性:需能灵活应对业务量增长和突发流量。

- 多维度数据处理:需支持对复杂、嵌套的JSON格式日志进行高效解析与丰富。

基于此,系统的设计目标聚焦于:高吞吐、低延迟、高可用、易扩展和准确一致。

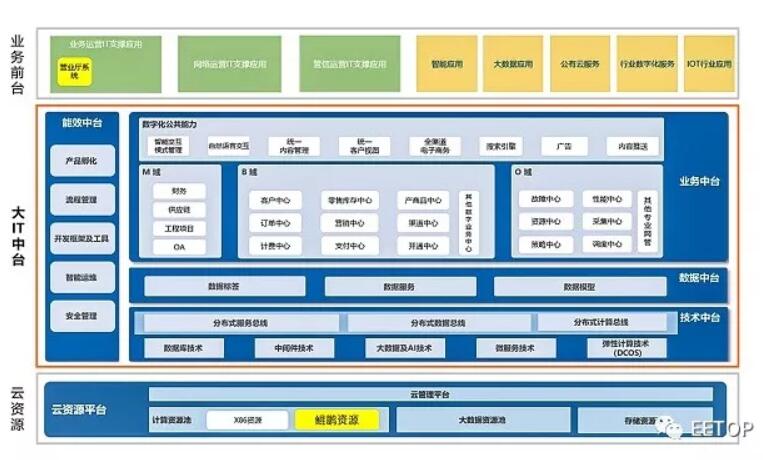

二、整体系统架构概览

携程实时用户行为服务系统采用分层、解耦的流式处理架构,核心模块包括:数据采集层、实时处理层、存储层与服务层。

1. 数据采集层:统一接入与缓冲

- 客户端SDK与埋点:在App、H5、小程序等终端部署统一埋点SDK,负责行为日志的规范化生成与初步压缩。

- 网关集群:接收来自全网终端的日志数据,进行轻量级校验(如格式、必填字段)、协议转换与负载均衡。

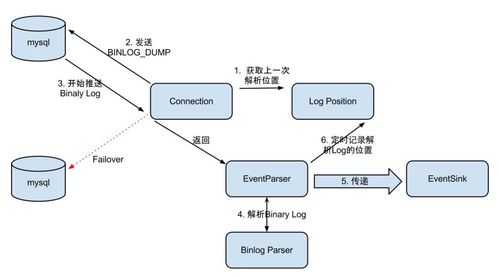

- 消息队列缓冲:选用高吞吐、低延迟的Kafka作为统一日志总线。采集层将数据写入不同的Kafka Topic,实现了生产与消费的解耦,并能有效应对流量峰值,为下游处理提供缓冲。

2. 实时处理层:流计算核心引擎

这是系统的“大脑”,主要负责数据的清洗、丰富、聚合与分发。

- 技术选型:采用Apache Flink作为核心流处理引擎。Flink凭借其精确一次(Exactly-Once)的语义保障、高吞吐、低延迟的特性以及丰富的状态管理能力,完美契合实时处理需求。

- 处理流程:

- 数据解析与清洗:消费Kafka原始数据,解析JSON,过滤无效数据(如格式错误、测试数据),补全基础字段。

- 数据丰富(Enrichment):通过查询维表(如用户画像、产品信息)或实时计算,为行为事件打上丰富的上下文标签(如用户等级、产品类别、地理位置信息)。维表数据通常存储在Redis或HBase中,通过异步I/O或查询缓存优化性能。

- 关键指标实时聚合:利用Flink的窗口(如滚动窗口、滑动窗口)功能,实时计算如页面PV/UV、搜索热词、转化漏斗等核心业务指标,结果直接输出至实时OLAP数据库或监控大屏。

- 数据分发:将处理后的标准化行为事件流,根据下游业务需求,实时写入多个目标系统,如:

- 实时数仓/OLAP:写入ClickHouse、Doris等,支持实时多维分析。

- 推荐与风控系统:通过消息队列或RPC接口直接推送。

- 离线数仓:同时归档一份至HDFS,供后续离线深度分析与模型训练。

3. 存储层:多模存储应对多元场景

根据数据的使用特点,采用不同的存储方案:

- 实时明细与查询:使用ClickHouse,其列式存储与向量化引擎非常适合对海量行为明细进行快速即席查询。

- 用户画像与维度数据:使用Redis(热数据)和HBase(全量数据),提供高并发的点查服务。

- 长期归档与批量分析:使用HDFS,结合Hive/Spark进行T+1的离线作业。

4. 服务层:统一数据服务出口

构建统一的实时用户行为数据服务API,对下游业务方(如推荐、营销、风控)提供标准化的数据查询与订阅服务,屏蔽底层存储与系统的复杂性。

三、数据处理服务的关键实践

- Exactly-Once语义保障:在整个处理链路(Kafka -> Flink -> 下游存储)中,通过Flink的Checkpoint机制、两阶段提交(2PC)Sink以及事务性写入,确保了端到端的数据精确一次处理,这是数据准确性的基石。

- 动态资源与弹性伸缩:基于Kubernetes容器平台部署Flink Job,可根据流量负载自动扩缩容TaskManager实例,实现资源利用率最大化与成本优化。

- 多租户与资源隔离:通过Flink的集群模式和队列管理,将不同重要等级的业务处理Job进行资源隔离,避免相互影响。

- 全链路监控与告警:建立从数据采集、队列堆积、Flink作业延迟与反压、到下游存储健康度的全方位监控体系,并设置智能告警,确保系统SLA。

- Schema管理与数据治理:制定统一的行为数据Schema规范,并建立中心化的元数据管理,确保数据口径一致,便于维护和追溯。

四、与展望

携程的实时用户行为服务系统通过以Kafka为中枢、Flink为计算核心的分层架构,成功应对了日均20亿级数据的实时处理挑战。其成功的关键在于对高可靠流处理技术的深入应用、合理的多模存储选型以及贯穿始终的数据治理与运维体系。

随着实时计算需求的进一步深化,该架构将持续演进,例如:探索流批一体技术以简化架构,引入机器学习平台实现实时行为数据的在线推理与预测,从而更好地赋能业务智能决策,提升用户体验与平台价值。